Vol.11 LLMの推論能力向上に関する最新研究

「LLMを使って推論能力を上げたい」っていうのを今みんながやろうとしています。

難しい問題を解きたいし、実用的なタスクを使う時にも「今のLLMでは理解力が足りないな」とか、「指示に従ってくれないな」とか、そういうのを推論能力って呼んでますけど、その推論能力をもっと上げたいと考えられています。

◆現在のアプローチとその限界

その時に一つ有効な方法として、モデルに指示や問題を与えて複数の答えを出した時に、その出した答えを別の検証機もしくは報酬モデルが、どの答えが良かったかを独立に判定することによって性能を上げるというようなことがされています。

一方でそのアプローチは、どの答えが良かったかっていうのを判定するために別に訓練されたモデルが、LLMが持っているような生成能力とか、LLMが使っている大量の学習データとかを必ずしも活用できていない。LLMは思考連鎖(CoT)などでものすごく能力を引き上げているので、そういった部分が活用できてないのがもったいない。

且つ、システムとして2つに分かれているので、複雑になってしまうという問題があります。

◆新しいアプローチの提案

そこで、このチーム(Google DeepMind、University of Toronto、Mila、UCLA)は、LLMが問題に対して答えを出す。その後にLLM自身がその答えに対して検証を始めて、その検証の結果、この検証が合ってましたっていうような結果みたいな、それが全部一つの並びになったようなデータを作ります。

これを単純に次のトークン予測として学習をして、これによってまとめて答えを出すモデルと、その後ろの部分の出した答えを検証する部分の学習っていうのを一つの枠組みでできるというような方法を提案しています。

◆提案手法のメリット

この方法のいいところは、後半の検証(出した答えが正しいかどうかを調べる部分)は、思考連鎖を使って投入するトークンの数を増やせば増やすほど性能が上げられるので、推論時にかける計算力を上げれば上げるほど性能がいくらでも引き上げられますよっていうような感じになっています。

あとは、たくさんの別々の推論を違う形の考え方をすると、その違う考え方をして最後に多数決を取るっていうやり方をしてもそれでも性能が上がるということで、その両方のところで最終的な検証の能力をガッと上げることができます。

検証能力も上がったので、先ほど言ったように、もともと目的だったLLMの答えを出して、その検証をして、どれが良いかを選ぶ、というのをやると、問題を解く能力をグッと引き上げることができました、というのがこの論文です。

◆具体的な問題と実験結果

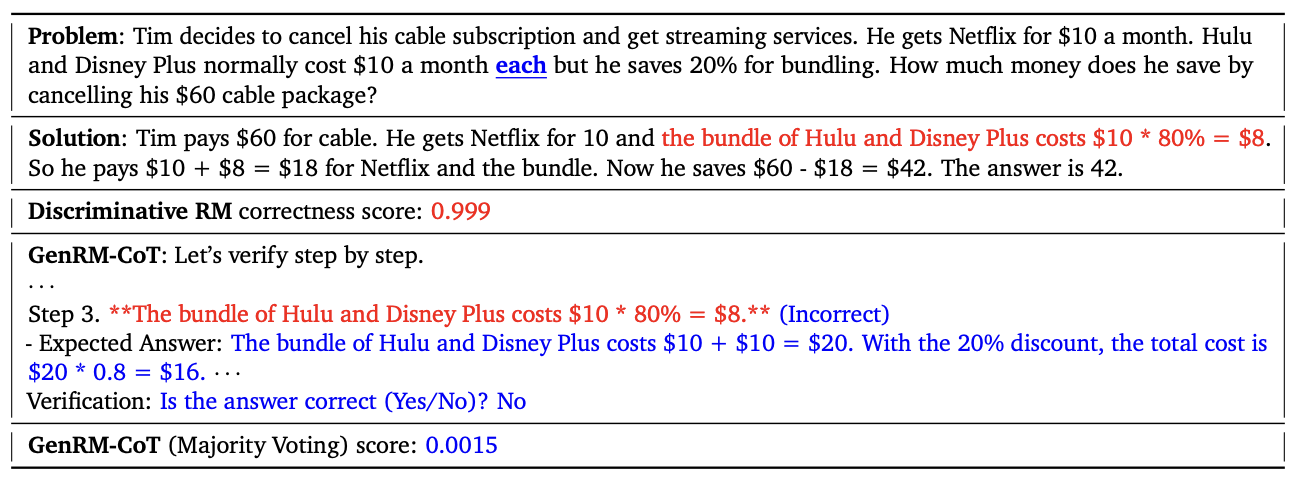

例えば具体的な問題でいうと、上記のような問題文があって、まずこのモデルが出した答えがあって、この後に普通はソリューションに対して独立にこの出した答えが合ってるかどうかっていうモデルがいるんですけれども、このモデル自体が何も言語の能力も使わずいきなりこれを与えられて分類するだけなので、結構難しい問題を解いています。

これに対して、GenRM-CoTは、この答えが合っているかどうかという検証をステップバイステップで検証しましょうというようなことをやっています。

ステップごとに分解して検証して、これが正しくなかったということで、最終的にverificationで”Is the answer correct?”で”No”を出すというようなことをしていて、これ全体をできるように次のトークン予測で学習をしています。

今これは見やすいように1個しか出してないですけども、多数決を取る場合には、検証部分が例えば32個の別々のモデルが別々の検証をする、というようなことをしています。これによって推論能力を上げることができています。

◆まとめと今後の展望

この論文ではいろんな実験をしていますが、必ずしも本当の答えが分かっていない場合でも、思考連鎖とか多数決を取ることによって、1個のモデルを作った場合よりも正確な検証が得られるので、それを教師と思ってどんどん学習をしていくことによって性能を上げられるという報告をしています。

こういう考え方はずっと昔からあって、生成モデルでは生成器と識別器といったり、強化学習で言えば、行動を生成する方がアクター(行動する側)で、生成された結果を評価する方がクリティック(批評家)と言って分けています。

アクターとクリティックと分けた方がやってる問題が違うので良い部分があります。LLM自身も、生成して批評して、そして批評できるようになった結果をシグナルとして、ちゃんと批評している人がいいよって言ってくれるような良い生成ができるように修正する、という順番で自分自身を引き上げていく形で学習していきます。

こういうのをみんな最近目指してやっていて、これでうまくいくとself-improvement(どんどん自分自身で賢くなっていくような)ループに入れるといいねという意味で、いろんな研究が出ていると思います。