Vol.22 クローズドモデルとオープンモデルの対決

◆ クローズドモデルとオープンモデルの現状

現在のLLMの開発状況については、先行する商用クローズドモデルとOSSがあります。これまで、驚くような性能をもったクローズドモデルが劇的に登場した後も、しばらく経つとそれを無料で使えるようなオープンモデルが登場します。

クローズドモデルの代表例はGPTシリーズやClaude、Geminiですし、オープンモデルの代表例はLlama、Qwen、Deepseekなどです。

一つの組織の中でもクローズドモデルとオープンモデルの両方を出している場合もありますし(例えばGoogleはクローズドなGeminiとオープンなGemmaの両方リリースしている)、一つのモデルでライセンス的に中間的なものがあります。

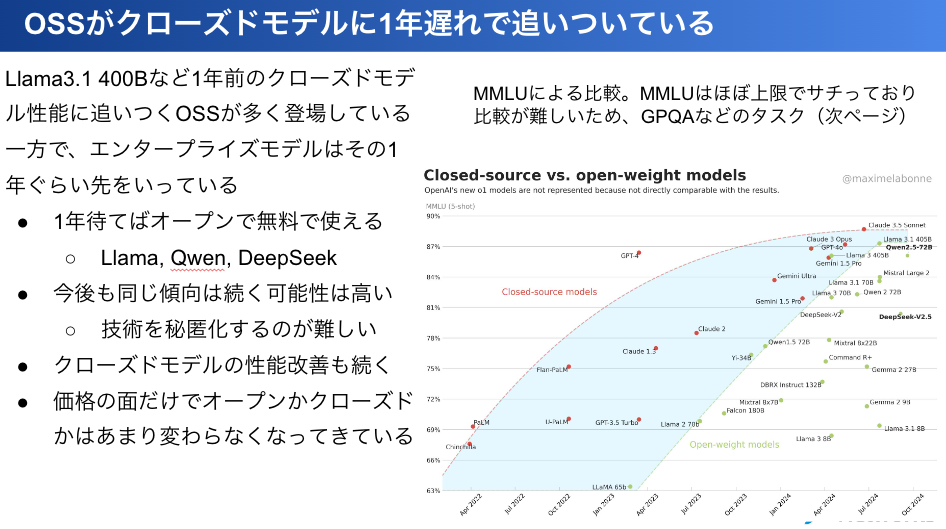

これまでの数年間は、基本的にはクローズドモデルが最初にベンチマークなどで先行しますが、オープンモデルの方が必ず追いつく構図が続いています。

例えば下の図では、MMLUとよばれるタスクにおいて、時間が経つごとに赤のクローズドモデルに対し、緑のオープンモデルが追いついている様子です。この下の図のように時間がたてば全部オープンモデルがクローズドモデルに追いつくんじゃないかとか、そういう話があります。

言い方を変えれば、1年待てば最先端のモデルはオープンで無料で使える可能性があります。

しかし、上の図には問題があって、このベンチマーク上のスコアが達成可能な上限に達してしまっている、いわゆるサチってしまっていて、そこでは追いついているのかなと思います。他のタスクではまだ差がついている場合もあります。

また、先行しているクローズドのエンタープライズモデルは性能や機能面でまだ逃げていますので、今後もクローズドが逃げてオープンが追いつこうとするという構図は続くのかなと思います。

ただやっぱり、何か圧倒的なアドバンテージを長期間守るっていうのは難しくて、例えばどのような技術を使っているのか公開していないOpenAI o1, o3についてさえも既に、他企業や組織がそれと似たような学習を提案し性能に追いつこうとしています。2025年には再現されていてもおかしくないと思います。

また、オープンの方は基本的に追いつく側なので完全に新しいものを作るよりは、ある程度成功が約束されているような手法や目標に向かっていくので、少ない開発コストでできるという部分でも有利です。

(Sam Altmanもリリースしたらすぐ真似される状況について反応したコメントをしています→ https://x.com/sama/status/1872664379608727589)

一方で、オープンモデルでも(おそらく、クローズドモデルでは積極的に採用されていないような)新しい技術が導入されて進んでいる例があります。

例えば、2024年12月26日にDeepSeek V3がリリースされました。これはオープンモデルであり、671Bパラメータ、37BだけアクティブなMoEモデルです。

ベンチマークとしては従来のオープンだけでなくクローズドモデルに匹敵する性能を達成していますし、推論コストが抑えられています(計算コストとしては1トークンあたり37Bパラメータ分だけしか必要としない)。

(模倣している部分は多くありますが、)使っているアーキテクチャや学習手法などは新しいアイデアがあり、何より使える計算資源が限られた中で工夫して追いついている部分はあると思います。

利用者からすると、クローズドとオープンのどちらが良いかというのも難しくなっています。価格の面だけで言うと、オープンかクローズドは特にクラウドなどでデプロイしたときほとんど差がなくなっています。

例えばLlama3を普通の会社が利益度外視で、クラウドの費用だけでデプロイして提供しているコストと、OpenAIやAnthropicがAPIで提供しているコストって、ほぼ変わらないので、価格の面だけでは別にどっちでもっていうような感じにはなっています。

2025年以降もクローズドモデルとオープンモデルとの開発競争は続いていくとみられます(それぞれの中に無数の開発チームがあります、PFNのPLaMoもその中の一つです)。過去の競争の歴史の中から学べる部分もありつつ、今回のLLM開発についてはどのような戦略をとっていくのがよいのか試行錯誤しながら進んでいく必要があります。