Vol.38 高性能になったPLaMo Primeリリース #1/2

5月22日にPLaMo 2.0 PrimeのAPIをリリースしました。

私たちが今開発しているPLaMoの新しいバージョンをAPIを通じて提供するもので、チャットと翻訳は登録すれば自由に使うことができるようになっています。

使ってみるにあたって、私たちから1000万トークン分の無料クレジットを提供していますので、是非試していただけたらと思います。

このPLaMoは、経済産業省とNEDOが生成AI開発支援を行っているプロジェクトGENIACの中で私たちが開発した成果をもとにリリースしています。

◆PLaMo 2.0 Primeの性能(ベンチマーク評価結果)

私たちはPLaMo 1.0 Primeというのを去年の12月にリリースしまして、その時は目標であった、日本語性能を評価するJasterと呼ばれるベンチマークで、1番高い性能を達成しました。

ただ、使っていくにあたって、社内で使ってもお客さんからしても、いろんな課題がありまして、今回その課題の解決に取り組んでいきました。一番大きな部分でいえば今回、性能を大きく改善し、それと同時に推論コストを抑えることで価格を下げるということができました。

今回のGENIAC第2期の開発においては、複数モデルを作り、私達のアプローチの有効性を確かめました。

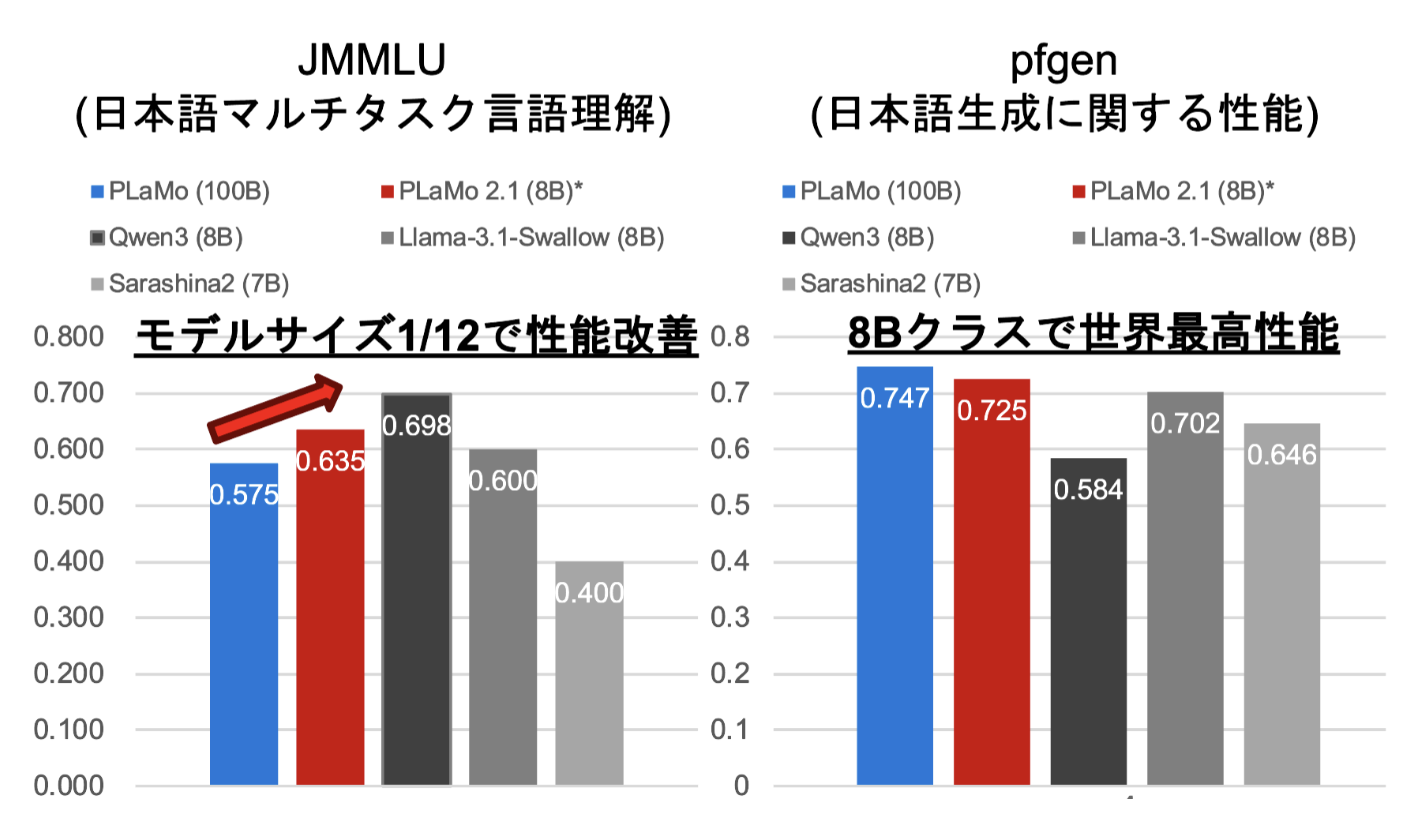

例えば、8Bっていう小さいサイズのモデルですが、この小さいサイズですらも前回作った100Bという大きいモデルよりも高い性能を達成しました。

元々、GENIACでは1/10のサイズで前のモデルよりも高い性能を達成することを目標にしていましたが今回はそれを達成することができました。

pfgenだと、ちょっと落ちちゃったけども、まあほぼ同じようなものができています。

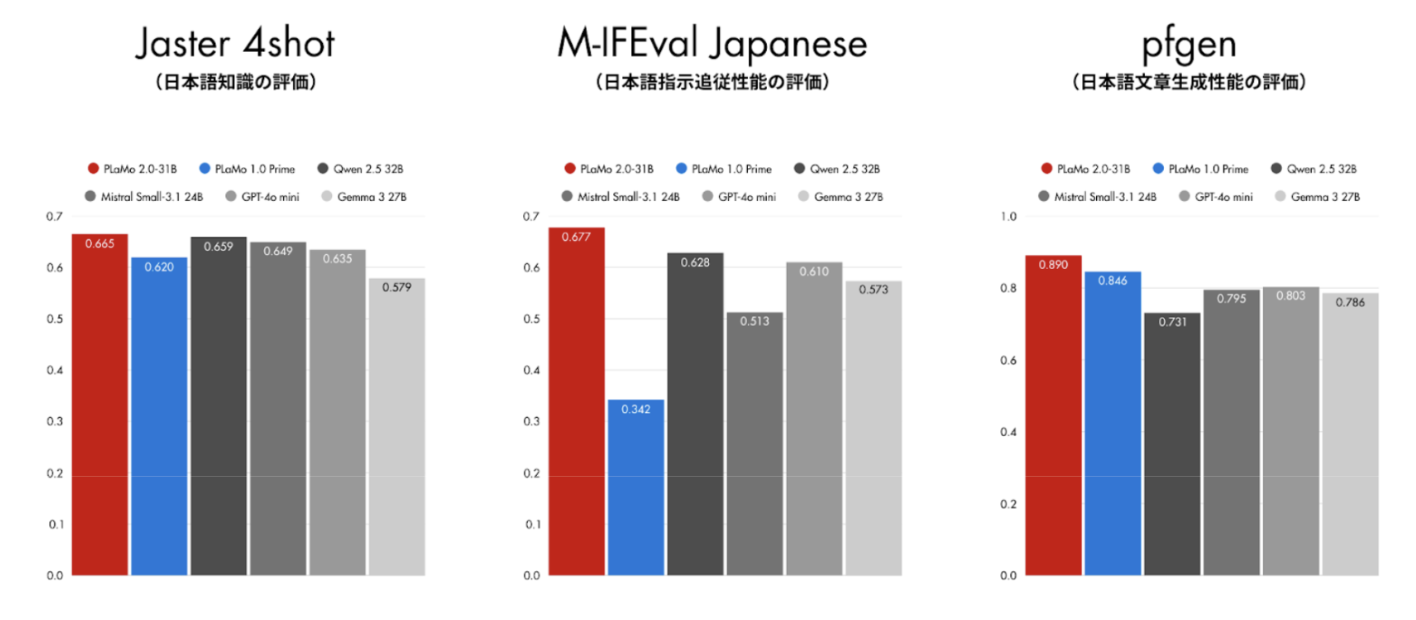

今回作った最大サイズである31Bモデルに関して言うと、同じ30Bのサイズのモデルで、世の中にリリースされているオープンモデルだとか、あとはおそらくそれぐらいのモデルサイズじゃないかなって思われているような商用のサービスと比較しても、高い性能を達成することができています。

特にですね、M-IFEval Japanese(日本語での指示追従性能)が前のPLaMo 1.0 Primeだと低くて、これが結果として、ユーザーが使っていて「指示を出してもちゃんと言うことを聞いてくれない」ということで使うにあたって問題があったんですけども、ここに関して、すべて解決とは言えないですがかなり改善をしていると思います。例えばQwenやMistral、 Gemmaの同サイズのモデルよりも高い性能を達成しています。

あとは、私たちが日本語の学習データセットだとか、そういったものを多く入れていますので、特に日本語生成の性能のところでは差を出しやすいです。

例えばpfgenと呼ばれる日本語や日本の様々な知識を問うようなところに関しても、同じモデルサイズの中では1番高い性能を達成することができています(右図)。

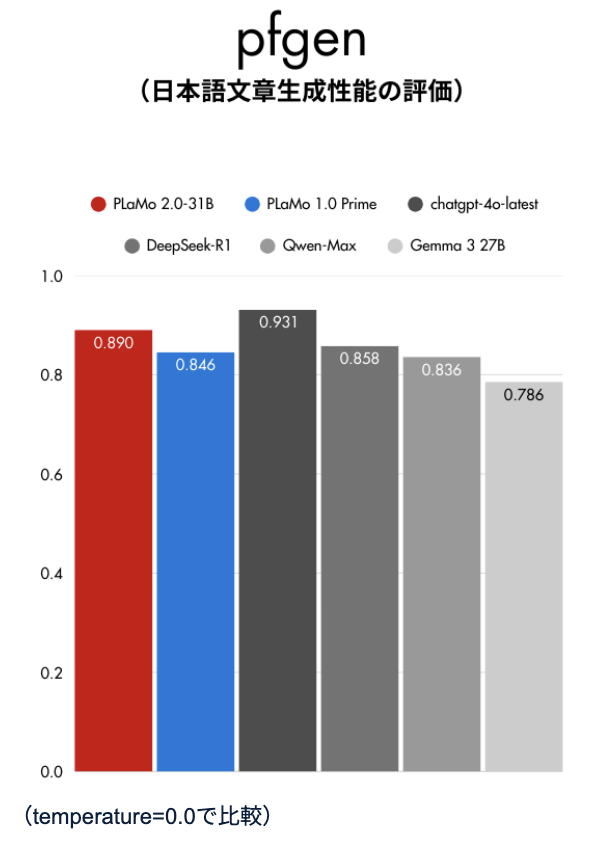

同じモデルサイズでの比較ではなくモデルサイズ無制限級のところで比較すると、さすがに1番進んでいて、おそらくモデルサイズも圧倒的に大きいようなモデルであるChatGPT-4oにはpfgenで負けてしまうんですが、DeepSeek-R1(モデルサイズは685B) だとかQwen-Max(おそらく>200B)とか、そういったものに対してはそれよりも高い性能を達成することができています。

◆4つの低価格である理由

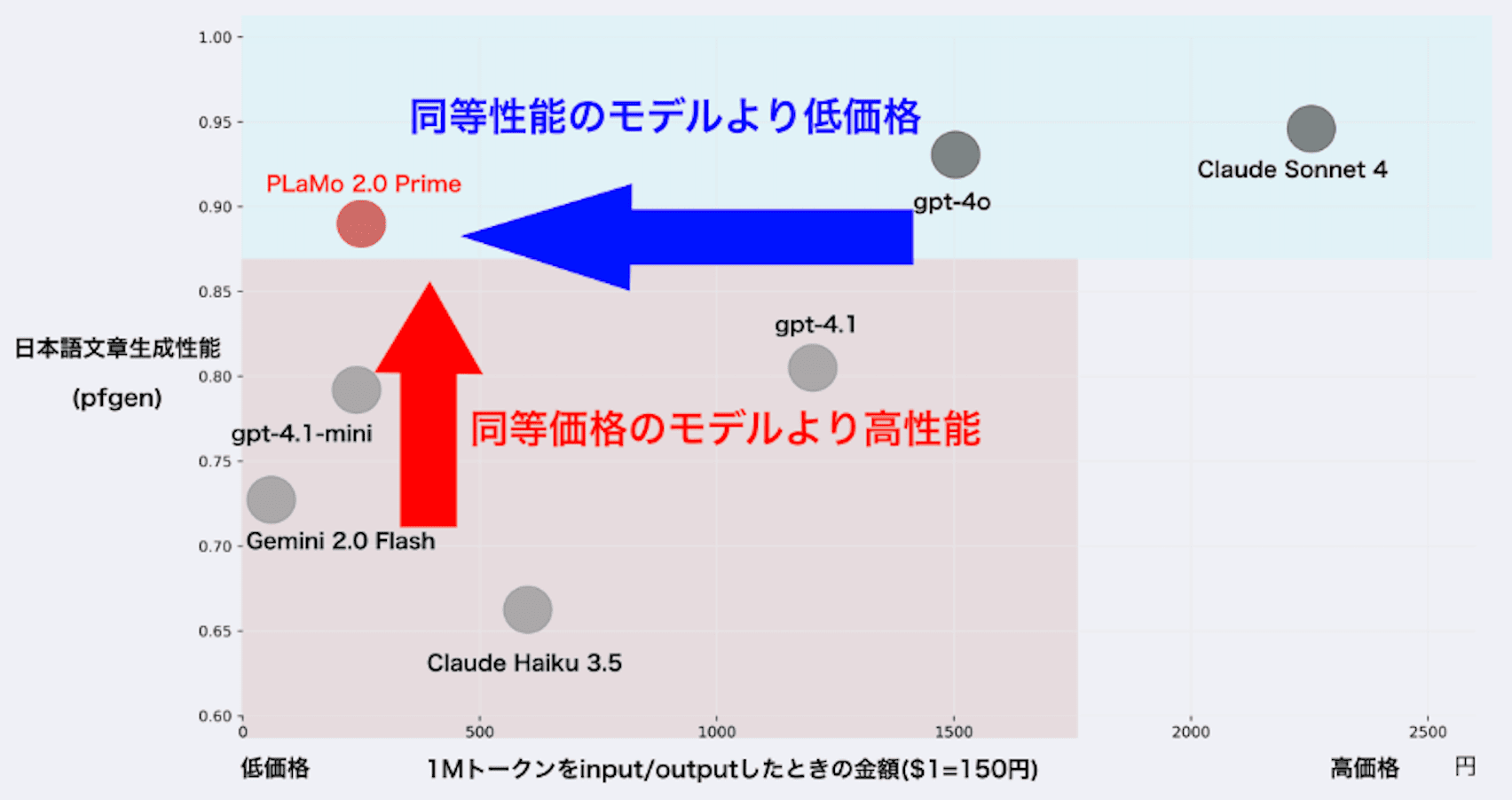

こういった高い性能を達成しながらも、逆に提供価格を抑えることができていて、従来のPLaMo 1.0 Primeと比べて約1/4、正確には出力が1/4、入力が1/5の価格設定をしています。

1Mトークンあたり入力が60円、出力が250円と設定しています。これは大体GPT-4o miniと同じような価格設定になっています。

これ、要はいくらぐらいなのよって感じだと思うんですけども、例えば、1回の会話が大体1kトークンぐらい。このブログ全体で大体1kトークン(例を除く)くらいなんですけども、それくらいの場合だと0.1円程度になります。

毎日対話とかでたくさん使う人でも、毎日10回で1年間話しても、500円未満で利用することができます。

例えば、今世の中であるような他のLLMのサービスなどで毎月何百円とか何千円とか使ってるものに比べたら、年間500円なので、かなり安く使えるかと思います。

私たちがなぜこのように価格を抑えてできてるのかについて、ちゃんと理由が分からないと気持ち悪いと思うので説明します。

(次回へ続く。後半は4つの理由について詳細に解説したトークです。)