Vol.51 対称性と機械学習

「対称性と機械学習」という本を岩波書店より2025年9月18日に出版しました。本は専門家向けと一般向け(とその中間)とターゲットを決めて書いているのですが、今回はかなり専門家向けの書籍です。今日は、その内容についてお話をさせていただきます。

◆なぜ「対称性」が重要なのか?

何についての本かというと、書いてある通り、対称性と機械学習の接点の話です。

元々、私がこの問題について興味を持ったところからスタートすると、人間が目で見たもので何かを認識したり、物の運動を予測する時に、「世界座標ではなくて自分が持っている自己座標で対象を捉えており、そのときにぐるぐる視点を変えて見たとしても、対象のものがちゃんと同じ物体としてずっと認識できる」ということが、どういう仕組みでできているのかが気になったと。

これ、人間には当然だから、なかなか難しさが分からないのですが、例えば画像認識で、フレームごとに認識している場合を考えます。このとき、カメラがグリグリ動く時、見た目がガラッと変わります。

カメラが左に動いたら、見ているものも画素レベルで一斉に動きます。自分自身が動いたり角度を変えたりした時に見た目がガラッと変わったものは、見た目が全く違うものなので異なるフレーム間で同じ対象のものとして見ることができないし、さらにその認識結果が壊れちゃうんですね。

このように機械学習で画像認識をする場合、ある瞬間で認識していて、次の瞬間でほんのちょっとだけ動いただけでも認識が破滅的に壊れちゃう、少なくとも一貫性はとれない。

しかし、人や動物はそういうことはない。自然に前の時刻と次の時刻でみた対象が紐づけられて一貫性をもてる。なので、少なくとも人や動物はそういう「視点不変な表現」を内部で持っていて、その表現を使っているおかげで、今の最先端の画像認識器が実現できないような安定した一貫性のある認識ができていると。

これはどういう仕組みなんだろう、というのを昔から考えていて、そこを考える上で「対称性」という概念が重要だというのが分かってきました。

◆対称性の多様な形:不変性と同変性

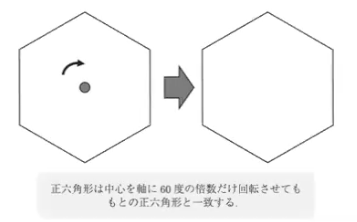

「対称性」というと、よく上記のような形状の対称性を思い浮かべると思います。例えば左右対称だったら、左半分のものを鏡で映すと右半分と一致します。(この図はいずれも「対称性と機械学習」の書籍からの引用になります)

あるいは正六角形の場合だと、60度回転させても全く同じ形になるし、蜂の巣のような構造だと、全く同じ構造が並進した形で何回も繰り返されるというような不変性があります。

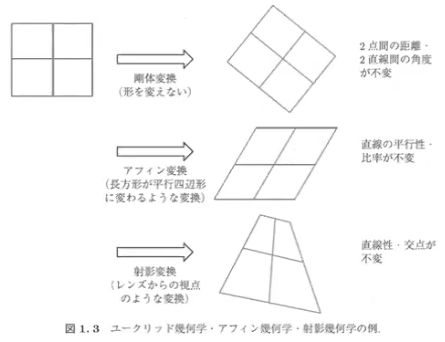

これらはさらに一般化できて、人間は視点が変わっても同じものだと思うような「射影変換」、例えば四角形がぐにゃっと歪むような、直線と交点の関係は保たれるけど他は全部変わってしまうような変換でも一緒のものだと分かります。

このように対称性というのは「変換」をした前後で不変であるような性質だと考えられます。このように考えると、対称性は形状だけではなく、もっと広いクラスで考えられます。

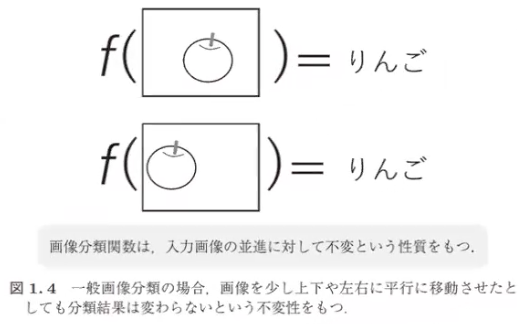

例えば画像分類で、りんごの画像を「りんご」と認識するなら、当然この「りんご」がほんの少し平行移動したものに対しても「りんご」と同じ結果を出してほしい。

さらに科学の例で、原子座標の配列から「水に溶けやすいか」などを予測する場合、原子の順序、つまり原子情報を並べた配列をシャッフルしたとしても、同じ結果が出てほしい。これも順序不変性が必要になります。

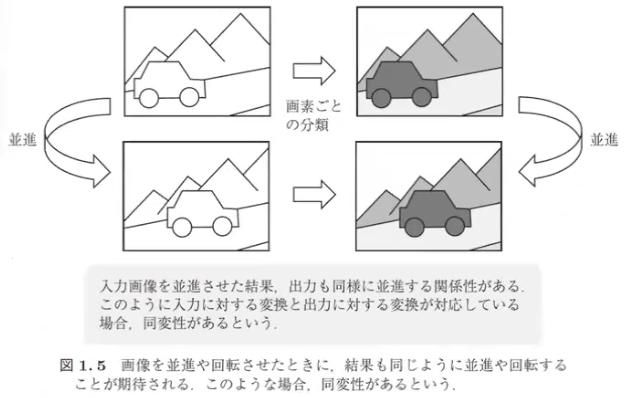

今話してきた不変性という対称性だけでなく、世の中ではもう少し広い概念で同変性とか、あと、物理の世界でいう一般共変性原理のように、式の形が変換後も保たれるという考え方もあります。

例えば、車のセグメンテーション(画素ごとに車か山かなどを分類するタスク)で、入力画像を平行移動させたら、出力であるセグメントも同じように平行移動してほしい。これは「変換してから分類する」のと「分類してから変換する」の結果が一致するという性質で、これを同変性と呼びます。

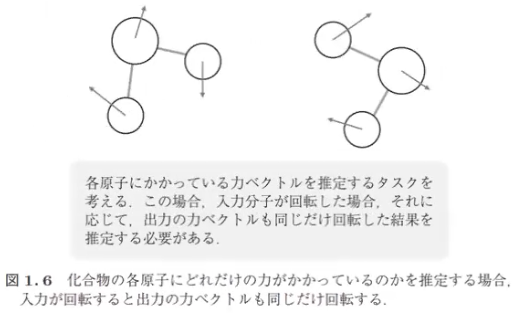

他にも、原子構造を入力して各原子にかかる力を予測する問題で、入力の原子構造を回転させたら、出力である力のベクトルも同じように回転してほしい。これも同変性です。

◆対称性を記述する数学の言葉:「群」と「リー群」

こうした入力の変化に対して不変性や同変性を持つような関数が、どのように数学的に、そして実用的に実現されるか、というのがこの本のテーマです。

この本では、対称性を扱う上で非常に重要な概念として「群(Group)」というものが出てきます。これは何かというと、「変換の集合」が持つ性質になります。

例えば、15度回転、30度回転といった様々な変換がたくさんあるわけですが、これらがただの集合だと、無限にあって法則性もないので手が出せません。しかし、それらが「群」と呼ばれる性質を持っているおかげで、色々な法則が成り立つことを示せます。

一般に 「群」とは、以下の4つの法則を持つ集合です。

- 閉じている: 2つの変換(例:回転)を合成すると、必ず1つの変換になる。

- 結合法則: 3つの変換をどの順で組み合わせても結果は同じになる。

- 単位元: 何も変換しない(回転させない、移動させない)という要素が存在する。

- 逆元: どんな変換に対しても、それを元に戻す(キャンセルする、Undoする)逆の変換が必ず存在する。

この4つの法則だけから、いわゆる群論や表現論といった、ものすごくたくさんの性質を導き出すことができます。

さらに、群の中でも、我々が自然界で目にする回転や並進といった連続的な変換の多くは「リー群(Lie group)」と呼ばれる特殊な群で表せます。リー群は、変換の集合が滑らかで扱いやすい構造(微分可能な多様体)をもっているという性質を持ちます。

さらにリー群の優れた性質として、単位元(全く変換しない点)をほんの少しだけ周りに動かしたときの微小な動き(接空間)を調べると、そこが「リー代数(Lie algebra)」と呼ばれるベクトル空間になっていて、この無限小な動きの部分だけを調べることで、リー群全体の性質が分かるというものがあります。

◆ニューラルネットワークへの対称性の導入

今話した「リー群」と「リー代数」の知識を使って、機械学習、特に最近だとニューラルネットワークに対称性を導入していくことができるようになっています。

例えば、グラフニューラルネットワーク(GNN)では、並進や回転に対して不変な結果を出せるようなネットワークを作ることができます。

「どういう関数であれば対称性を備えることができるのか」、あるいは「対称性を持つための必要条件は何か」、といった理論的な話もあります。結論から言うと、これは「一般化群畳み込み」というものでなければいけないと分かるのですが、そういった話がこの本で解説されています。

さらに、回転と並進だけでなく、少し潰れるような変換を含むアフィン群に対して同変なネットワークや、そもそも一般のリー群に対して同様のことができるような方法も発展しています。

◆応用と未来:未知の法則の発見と新たな数学的ツール

これらの対称性と機械学習の最新はどうなっているかというと、例えば実験データをずっと見ていて、その中に隠れている対称性を見つける、というようなことができるようになります。

まだ人類が見つけていないような法則、例えば「こういう場合はこういう量が保存される」とか「入力がこう変わった時に出力は決まった形で変換される」といった、未知の保存則や対称性を観測データから発見する手法ができています。

元々、未知の法則を見つけるということが、自動的に実現される可能性がでています。物理や化学では観測データからエネルギー保存則などを見つけ、その背後にある方程式があるのではと歴代の科学者は考えてきましたが、同じようにこうした対称性やそれによって生み出される保存則などは科学だけでなく、社会科学のような分野でも行われています。

最後に、クリフォード代数(幾何代数)という、また全く別の数学的な道具立てが出てきます。このクリフォード代数を使うことによって、対称性や幾何学(ジオメトリー)をうまく扱うことができるようになります。

この技術については、まだ日本ではほとんど普及していないのですが、幾何や対称性を扱うには非常に便利で協力なツールです。この本ではそういった内容も紹介しています。